AI Act: què ha de saber avui qualsevol empresa

- Dec 6, 2025

- 6 min de lectura

Actualitzat: Dec 9, 2025

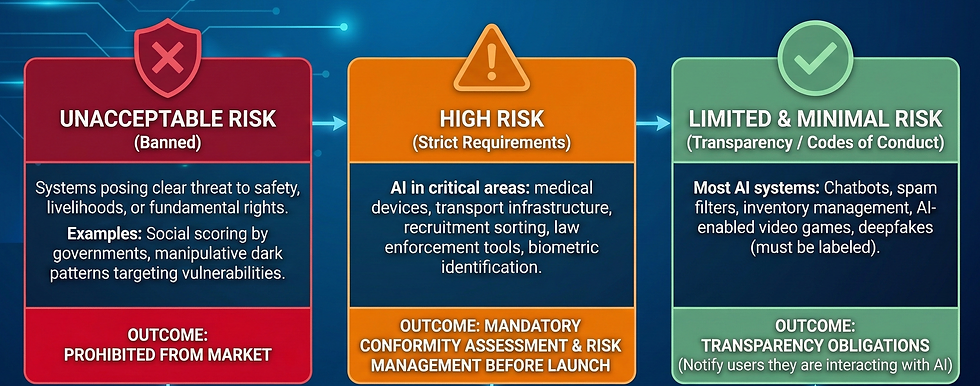

Europa ha llançat el primer marc regulador complet del món per a la intel·ligència artificial.

AI Act és ambiciosa, contundent i ineludible. Tant si esteu experimentant amb ChatGPT, integrant eines de IA de tercers com si esteu construint els vostres propis productes, la regulació se t'aplica.

El que moltes empreses no saben és que des de l' 1 d'agost del 2024 la Llei d'IA ja està en vigor . Això no vol dir que totes les obligacions apliquin d'un dia a l'altre, hi ha un calendari progressiu, però el compte enrere ha començat: algunes pràctiques prohibides es vetaran en qüestió de mesos i les normes més estrictes per als sistemes d'alt risc arribaran després.

Així que, quines són les conseqüències avui? Has d'actuar ja, encara que “només” utilitzeu ChatGPT internament?

Aquesta guia està dissenyada per respondre exactament a això: què importa ara, què pot esperar i com evitar despertar-te d'aquí a dos anys amb un problema de compliment que podries haver resolt en dies.

Què és l'AI Act i per què afecta totes les empreses?

L´AI Act és una proposta legislativa de la Unió Europea que regula l´ús de la intel·ligència artificial. La llei no es preocupa per si fas servir ChatGPT, un model intern petit o una API de tercers.

El que realment importa és el teu rol i el que fas amb la tecnologia . La regulació traça una línia clara entre dos actors:

● El proveïdor - qui construeix, entrena o empaqueta el sistema d'IA.

Si toques el motor, personalitzes el model o distribueixes una solució, estàs jugant a la lliga alta del compliment.

● L'usuari (deployer) - qui utilitza la IA dins de l'organització.

Si depens de les eines creades per altres, ets usuari. Menys obligacions, sí, però també responsabilitats clares.

I aquí hi ha la part que la majoria d'empreses passa per alt:

El risc no ve del model - ve del cas dús.

Un xatbot que explica la política de vacances: baix risc.

Una eina de classificació de documents: innocent.

Una eina de classificació que prioritza pacients o candidats: estrictament regulada.

El missatge és simple:

La Llei d'IA obliga les empreses a examinar no només la tecnologia, sinó la intenció i l'impacte darrere seu. Així que abans de preguntar “amb què hem de complir?”, pregunta't dues coses que determinen tot el que ve després:

Quin rol desenvolupem - proveïdor o usuari?

Per què fem servir exactament la IA ia qui afecten aquestes decisions?

A partir d´aquí es desplega tota la lògica regulatòria: obligacions, transparència, documentació, supervisió i risc.

Preguntes més freqüents sobre AI Act

"No tinc ni idea de què és la Llei d'IA. Què regula?"

La Llei d'IA regula com s'han de dissenyar, desplegar i supervisar els sistemes d'IA a la UE.

Defineix què compte com a sistema d'IA (Art. 3), estableix normes per a desenvolupadors i usuaris, i garanteix transparència, seguretat i supervisió humana. S'aplica a qualsevol organització que faci servir o proporcioni IA dins de la UE.

Referència: AI Act Art. 3

"Què passa si una empresa no compleix la Llei d'IA?"

La Llei dIA no és un document teòric: ve acompanyada dun règim sancionador molt real.

Les multes poden ser extremadament altes, especialment per a empreses mitjanes i grans:

● Pràctiques prohibides: fins a 35 milions d'euros o el 7% de la facturació global anual, el que sigui més gran.

● Infraccions greus: fins a 15 milions o el 3% de la facturació.

● Informació enganyosa a autoritats: fins a 7,5 milions o l'1% de la facturació.

Per a pimes i startups, s'aplica l'import menor, però les conseqüències continuen sent severes: tancament de projectes, pèrdua de clients i barreres per entrar en processos de contractació pública o corporativa.

"Només fem servir ChatGPT internament. Ens afecta la Llei d'IA?"

Sí, però de manera lleugera. Se us considera usuaris , no desenvolupadors.

Les vostres principals obligacions són:

● utilitzar l'eina de manera responsable,

● evitar pujar dades sensibles o personals,

● aplicar supervisió i verificació bàsiques,

● crear una política interna d‟ús d‟IA generativa.

No necessiteu certificacions ni auditories en aquesta fase.

"Fem servir diverses eines d'IA de tercers. Què exigeix la Llei d'IA?"

Us convertiu en usuaris responsables , cosa que implica:

● assegurar que el proveïdor ofereixi instruccions d'ús clares i limitacions,

● formar el vostre personal,

● monitoritzar el sistema per detectar errors,

● assegurar que les dades que introduïu siguin adequades,

● reportar incidents si alguna cosa greu passa.

Usar IA no és passiu: l'empresa continua sent responsable.

“Quins canvis pràctics ha d'esperar la meva empresa?”

Heu de preparar-vos per:

● documentar on i com feu servir IA,

● definir polítiques internes d'IA,

● augmentar la transparència en processos impulsats per IA,

● aplicar supervisió humana quan sigui rellevant,

● verificar els vostres proveïdors,

● preparar evidència bàsica de compliment.

A més, les organitzacions que desenvolupen la seva pròpia IA han d'implementar governança, controls de qualitat i estructures de documentació.

"Què deuen saber realment els usuaris d'IA en fases inicials?"

Si estàs experimentant amb IA generativa, les teves responsabilitats principals són:

● protegir les dades,

● supervisar les sortides,

● garantir un ús ètic,

● assegurar transparència cap als usuaris o empleats afectats.

Encara no hi ha compliment pesat.

Com et pot ajudar SOMIA Solutions a complir el reglament

La missió central de Somia és senzilla:

donar-te una plataforma on el compliment de la Llei d'IA ja està integrat , perquè et puguis centrar en crear valor —no en navegar regulació.

Fes servir la plataforma sabent que transparència, traçabilitat i supervisió ja estan preconfigurades.

✔ Registres automàtics i traçabilitat

Cada interacció, acció i decisió queda enregistrada.

Sempre tens un historial complet llest per a auditories.

✔ Validació humana quan la necessitis

Ja sigui un flux, un document, un missatge o una decisió, podeu activar aprovació humana a demanda.

✔ Us guiem en la definició dels vostres casos d'ús

Somia t'ajuda a entendre, refinar i estructurar els teus casos d'ús, i implementar-los de manera segura a la nostra plataforma, alineats amb la lògica de risc de l'AI Act.

✔ Funciona amb qualsevol model d'IA

OpenAI, DeepSeek, models open source…

Somia garanteix que sortides, registres i processos compleixin la normativa europea, sense importar quin model hi hagi a sota.

Coneix més sobre els nostres serveis

En vols saber més?

Si vols entendre com Somia pot ajudar la teva empresa a utilitzar IA de manera segura, responsable i alineada amb la Llei d'IA de la UE, sol·licita una demo.

A més de solucions privades, és important destacar que governs i institucions públiques també ofereixen suport perquè les empreses comprenguin i adoptin pràctiques responsables d'IA.

Una iniciativa molt recomanable és l' Observatori d'Ètica a Intel·ligència Artificial de Catalunya (OEIAC)

L´OEIAC forma part de l´estratègia Catalonia.AI de la Generalitat de Catalunya i està dedicat a promoure l´ús ètic i responsable de la IA en línia amb la regulació vigent.

Juntament amb el Govern de Catalunya, l'OEIAC ha llançat el Manifest per una IA fiable i ha reforçat el compromís amb una IA segura, transparent i legalment complidora.

Per a les empreses, això és crític:

L'OEIAC ofereix un marc gratuït d'avaluació ètica d'IA, que permet a les organitzacions fer una auditoria inicial dels casos d'ús.

Això ajuda a entendre riscos, identificar bretxes i alinear pràctiques amb expectatives ètiques i reguladores sense cost.

Conclusió

L'arribada de l'AI Act no s'ha de veure com una amenaça, sinó com una oportunitat per millorar la qualitat i la seguretat en l'ús de tecnologia. A Somia , creiem en una intel·ligència artificial ètica, controlada i útil per a totes les mides d'empresa.

Comptar amb agents adaptats a l'entorn legal permetrà que les empreses no només evitin sancions, sinó que guanyin eficiència, reputació i sostenibilitat a llarg termini.

Avís Legal

Aquesta publicació només té finalitats informatives generals i no s'ha de considerar assessorament legal, tècnic o professional. No s'ha d'utilitzar com a base per prendre decisions o per deixar d'actuar en relació amb situacions específiques.

Qualsevol decisió relativa al compliment de la Llei dIA o altres regulacions aplicables sha de prendre amb assessorament professional adaptat a les circumstàncies particulars de cada organització.

L'autora no assumeix cap responsabilitat per accions realitzades o no realitzades basant-se en la informació continguda en aquest document, ni per les conseqüències que se'n puguin derivar.